最終更新日: 2024年7月12日

OpenAIは米国時間の11月6日、最新の大規模言語モデル「GPT-4Turbo」を発表しました。

パフォーマンスを大幅に向上し、高性能かつ安価で、128K(128000トークン)という膨大なコンテキストウィンドウに対応するとのことです。

具体的には、「300ページ」もの長文の回答が可能になるといわれています。

例えば書籍の要約や長時間会議の要約を分割せずに認識させることが可能になります。

また、以前のモデルでは学習データは2021年から2022年初頭まででしたが、今回のモデルは2023年4月まで対応です。

その結果、最新の情報に対応が可能になります。

なお、先んじて本日よりAPIで「gpt-4-1106-preview」を提供開始。

すぐ試したい方はOpen AIのPlayground画面から利用可能です。

(有料プランに加入しているなどGPT-4へのアクセスが許可されている方のみです。)

https://platform.openai.com/playground

ただし、API利用料金がかかります。

入力出力各種1000トークンあたり、入力トークンが$0.01。出力トークンが$0.03。

あわせて読みたい注目記事

コンテンツ

具体的には何が違うのか。

OpenAI DevDayで発表された新しいプラットフォームの更新について以下の要点にまとめました。

・新しいGPT-4 Turboの更新

・更新されたGPT-3.5 Turbo

・Assistants API

・多様なモダリティの機能

・ChatGPT内のカスタマイズ可能なGPTs

新しいGPT-4 Turboの更新

- GPT-4 Turboの発表。128Kのコンテキストウィンドウと2023年4月までの世界の出来事に関する知識を提供。

- GPT-4 Turboの価格を大幅に削減。入力トークンが$0.01/1K、出力トークンが$0.03/1K。ゆえに以前のGPT-4に比べてそれぞれ3倍と2倍安くなった。(従来GPT-4 APIは$0.03/1K,$0.06/1K)

- 関数呼び出しの改善。JSONモードで常に有効な関数を返す。また、正しい関数パラメータを返す精度を向上。

- 新しい再現可能な出力のベータ機能で出力がより決定的に。

- APIでgpt-4-1106-previewを指定することで早期にアクセス可能。また、年内に安定した本番モデルのリリースを予定。

更新されたGPT-3.5 Turbo

- 新しいgpt-3.5-turbo-1106はデフォルトで16Kコンテキストをサポート。入力$0.001/1K、出力$0.002/1K。低価格で長いコンテキストが利用可能。

- トレーニングデータを使用したベースモデル(ファインチューニング)のGPT-3.5を使うことができる。また、その使用コストが大幅に削減。入力トークンが$0.003/1K、出力トークンが$0.006/1Kに。

- gpt-3.5-turbo-1106は、改善された関数呼び出し機能。さらに、再現可能な出力をGPT-4 Turboと共有。

Assistants API

- アプリケーション内でエージェントのような経験を簡単に構築できる新しいAssistants APIのベータ版を導入。

- 特定の指示に従い、追加の知識を活用。また、さまざまなタスクを実行するためのモデルやツールと対話できる目的に応じたAIアシスタントの作成を可能にする。

- 開発者がコンテキストウィンドウの制約を回避してOpenAIにスレッドの状態管理を任せる永続的なスレッドをアシスタントが使用可能。新しいツールとしてコードインタープリター、リトリーバル、関数呼び出しを利用できる。

- プラットフォームのPlaygroundでコードを書かずにこの新しいAPIを試すことができる。

多様なモダリティの機能

- GPT-4 Turboは、キャプション生成や視覚分析などのユースケースを可能にするビジュアル入力をChat Completions APIでサポート。gpt-4-vision-previewモデルを使用してビジョン機能にアクセスする。なお、このビジョン機能は、年内にプレビューから本番環境に移行する際にGPT-4 Turboに統合される。

- DALL·E 3の画像生成をアプリケーションに統合することも可能。

- 新たに導入されたTTSモデルを通じて、テキスト読み上げ機能をリリース。6つの自然な音声の中から選ぶことができる。

ChatGPT内のカスタマイズ可能なGPTs

- GPTsという新機能を導入。指示、データ、機能を組み合わせて、ChatGPTのカスタマイズバージョンを作成。

- OpenAIが作成したDALL·Eや高度なデータ分析などの機能に加えて、開発者定義のアクションも呼び出すことができる。開発者がより大きな体験をコントロールできるようにする。ゆえに、プラグインとアクションを非常に似たアーキテクチャで設計し、既存のプラグインをアクションに数分で変換できる。詳細はドキュメントを参照。

コラム:オリジナルChatGPTアプリが作れる「GPTs」とはなにか:実際にGPTsを作ってみた

とのことです。

具体的な料金についてはOpen AIのページをご確認ください。

https://openai.com/pricing

GPT-4 Turbo これによって何が変わるのか。

実際に「GPT-4 Turbo」 によって何が変わるのでしょうか。

GPT-4 Turboは、128K(128000トークン)という膨大なコンテキストウィンドウに対応

いままでは数千から数万トークンしか1回の送信で送付することができませんでした。

そのため、どうしても長い文章などを送付する際には分割して送付。そのほかには一度英語に変換する。分割して送付して帰ってきた回答を要約したりと行っていました。

また、日本語は英語に比べ同じ分量でも使用トークン数が多いです。そのため、日本語で長い会議や書籍などを一気に送付しようとするとトークンが超えるという現象を起こしていました。

つまり、今回のGPT-4 Turboにより一度に送付でき情報が細切れにならずに済みます。その結果、一回の送付要約や意図を組んだ返答がかえってくる可能性が高まりました。

GPT-4 Turbo 1000トークンあたりの料金が安価に

ただ、先ほどのような長文となると送付するだけで数百円という金額がかかるという状況です。

そのGPT-4 APIは$0.03/1K,$0.06/1Kかかっていたところを、今回、入力トークンが$0.01/1K、出力トークンが$0.03/1Kとすることで従来よりも安くなりました。その結果GPT-4を身近に使うことができるようになりました。

実際利用すると顕著にGPT-3.5とGPT-4では精度に差が出ます。

そのため、安く使えることにより、高精度な生成を試すことができるようになりました。

トークンって何?

この「トークン」って何?って思われた方もいるかもしれません。

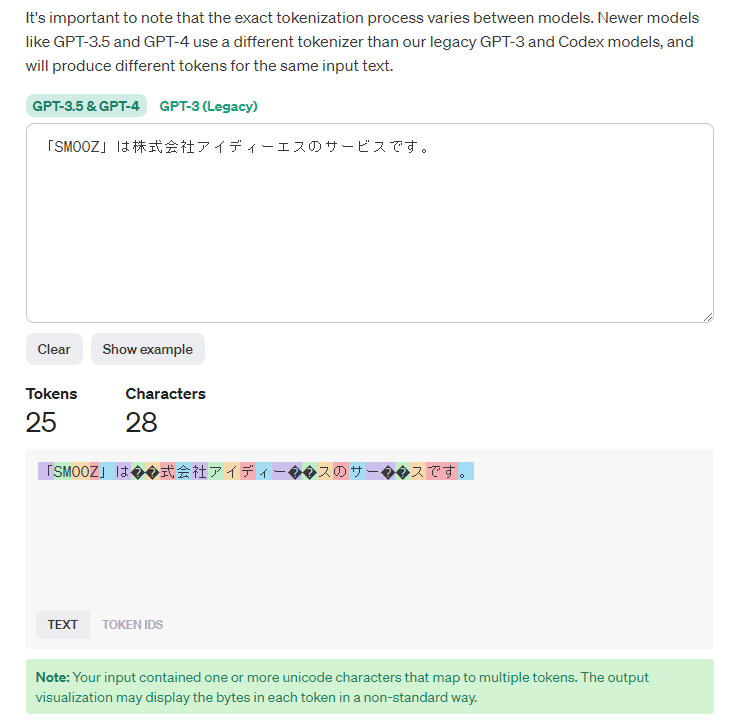

ChatGPTにおけるトークンとはテキストデータを分割・計算する単位のことです。

主に単語や句などがトークンとなります。

ただし、単に単語で切ったらその数になるわけではないので、その計算方法はOpenAIのページ上で公開されているTokenizerを使うことで特定できます。またどのようにトークン化されるのか、またそのテキストに含まれるトークンの総数を把握することができます。一度試してみることをお勧めします。

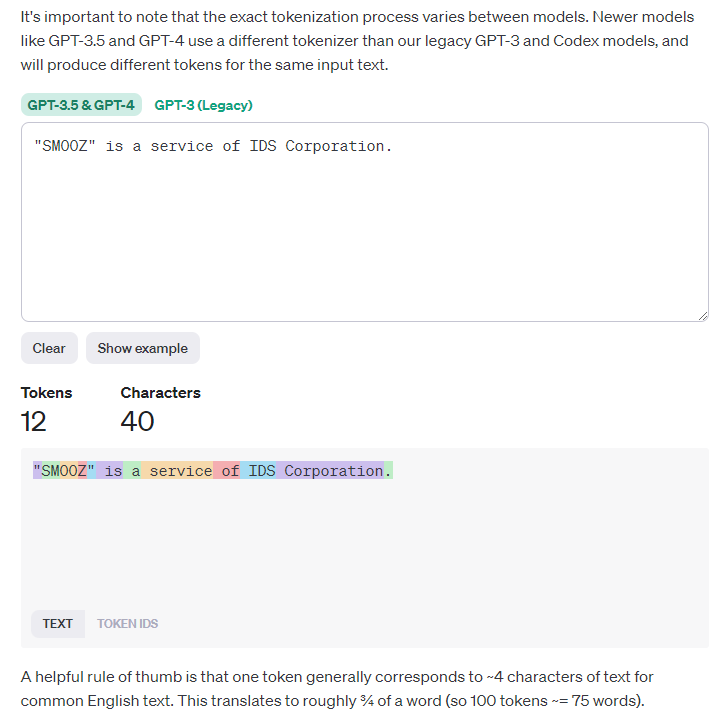

また、英語の場合にはアルファベットなのでシンプルなのですが、日本語の場合には漢字など複雑なものも多いです。そのため、同じ意味の文章を日本語と英語でトークン数を計算した場合には日本語の方が圧倒的にトークンが多くなります。これも、Tokenizerでぜひ試してみてください。

なので、先ほど申し上げた、長文の送付は一度英語に翻訳するというのはトークン数の節約のために行われる手段として使われています。

ゆえに、今回128000トークンと大幅な上限アップでかなりの量を送信することができるようにりました。

日本語と英語のトークン数の違いを比較をしてみた

簡単な文章でちょっと試してみたいと思います。

日本語:「SMOOZ」は株式会社アイディーエスのサービスです。

このような感じで25トークンと出ます。

英語:”SMOOZ” is a service of IDS Corporation.

こちらは英語です。なんと12トークンです。

つまり、トークンが半分ということは倍の文章は送付できるということです。

ゆえに同じ内容の文章であれば英語の方が料金が半分で済むということでもあります。

そのため、英語に翻訳してから生成AIに送付という手段もありますが、注意としては日本語から英語にした際に細やかなニュアンスがなくなる可能性は否めません。

これが128000トークンまで送付できるとなるとかなりの文章が送付できます。

ゆえに、大きいデータを一気に送付分析なども容易になります。

まとめ

いかがでしたでしょうか?GPT-4 Turbo with Visionについても注目されています。

そのため、今回の発表により今後考えられることとして

・GPT-4 TurbowithVisionを使い、画像の内容を理解しテキスト化する

↓

・意図をくみ取り返答を生成しテキスト化。

↓

・Text to speechを使ってテキスト読み上げ

といったようなことが可能になる可能性がありえます。

百聞は一見に如かずですのでぜひ一度使ってみるのをおすすめします。